LoopDNS资讯播报

- 过了腊八就是年,LoopDNS全体编辑祝各位万事“粥”全,岁月安暖。🥣✨

- 中国最高级别将领张又侠被指向美国泄露核机密

据了解相关高层通报会的人士称,中国最高级别将领被指向美国泄露有关中国核武器计划的信息,并为包括提拔军官担任国防部长等一些职务行为收受贿赂。

这场通报会于上周六上午举行,一些军方最高级别军官出席了会议。就在这场会议召开前不久,中国国防部发布重磅声明,宣布对张又侠上将进行调查。该声明除了披露对严重违纪违法问题进行调查外,几乎没有提供其他细节。

但据了解此次通报会的人士称,张又侠因涉“结党营私”问题以及在中央军委滥用职权而接受调查。相关部门还在调查张又侠对装备发展部的控制情况,该机构负责军事装备研发和采购。熟悉此次通报会的人士称,张又侠被指在这个预算庞大的采购系统中收受巨额资金以提供官职晋升。

这些人士称,在这次闭门通报会上披露的最令人震惊的指控是,张又侠向美国泄露了中国核武器的核心技术材料。了解此次通报会的人士说,一些针对张又侠的证据来自中国核工业集团前总经理顾军。中国政府上周一宣布对顾军涉嫌严重违纪违法问题进行调查。

cn.wsj.com -

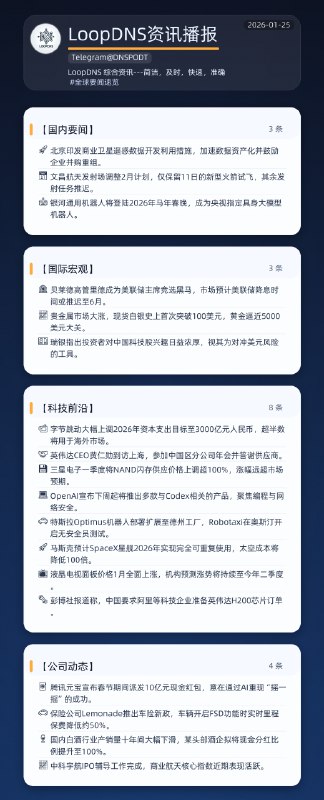

- 🌏 #全球要闻速览 2026-01-25

- Engram对比传统LLM,有什么区别?

通过将部分 Transformer 层替换为 Engram 模块,训练时将部分知识挂载在模型特定的embedding层,推理时可实现根据 input token 通过哈希映射获得相应的 embedding索引,并将对应注入到模型主干网络的 hidden state 中,其中哈希映射的逻辑没有LayerNorm和非线性激活函数,计算量非常少,意味者这部分可由cpu进行计算。传统LLM在推理时,由于知识可能分布在不同层的 FFN 中,因此每次推理都需要把所有层都计算一次。而 Engram 可能在每轮计算中,通过哈希映射已经找到了对应的知识,当这个向量注入到主干网络后,门控可以判断其能否作为输出的一部分,从而实现某种程度上的 early exit。

相比Cpu取代Gpu的叙事,更重要的是存算分离。

论文虽然提到了“20/80比例”,但同时证明了更大的知识层能使模型的loss下降依然遵循幂律,并且这是基于3B小模型上获得的实验结果。

目前MoE模型有着总参数大,但激活量小的特点。因为其在推理时只会激活 n 个专家,而激活量只相当于激活专家的总和。在推理时,却需要加载所有专家的权重。因此MoE会耗费非常多的显存,但计算却只需要相对于模型总参数量很小的一部分权重。

同时,由于MoE模型提前预测激活专家准确性较低,而且FFN非常厚重,通过远程内存阵列加载所有权重并流式读取在目前基本不可能,因为要低延迟其需要很高的传输带宽。目前大部分多卡分布式推理都是将模型分成多个切片在多张gpu上计算,这是极其浪费的。

而在Engram中,主干网络相对于embedding层来说,可能只需要保证拥有各领域基础的思维模式和基础知识,其余信息可通过哈希映射在embedding层中获取,这大大较少了模型计算的深度,提高了推理时的效率。

Engram 在前面几层就可以根据输入来获取哈希映射进而取出命中的“知识”,并且通过demo代码中 EngramConfig 可知,n_embed_per_ngram为512,n_head_per_ngram为8,在Fp16的情况下,只需要1kb的传输量。当然demo中hidden_size仅为1024,意味者这个demo对应的大概是1B左右的小模型。但即使生产部署的情况下,这个数值也不会很大,因为单个ngram的信息量只是一个词组。

由于其对比FFN而言,跨节点通讯所需的带宽大大减少。因此,用专门的内存阵列来存储low-rank知识层,单张gpu加载主干网络变得可行,并且不需要昂贵专用互联技术,进而提升目前硬件的计算效能。

同时,Engram 也使端侧算力有限的情况下,大模型能力提升提供了一条新的路径。

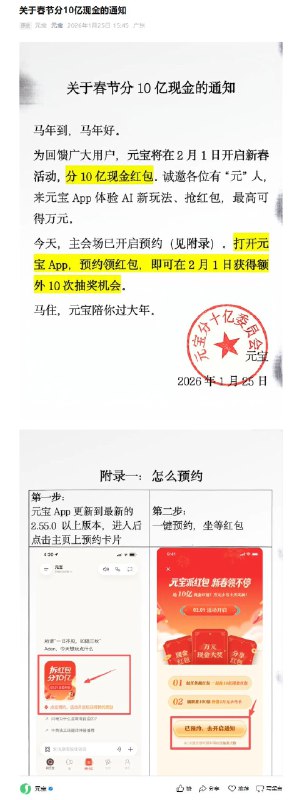

(独立撰稿 LoopDns) - 1月25日,腾讯旗下AI助手应用“腾讯元宝”发布《关于春节分10亿现金的通知》,宣布将于2月1日正式开启新春活动,向用户派发总额高达10亿元的现金红包。

据腾讯内部人士向《科创板日报》记者透露,元宝即将上线全新玩法,已启动内测邀约。另外,腾讯公布的产品界面图中已悄然新增一个名为“派”的底tab入口。

source - 明尼阿波利斯再度发生联邦执法人员开枪致死事件,一名37岁美国籍男子被多名联邦特工压制在地后遭近距离射击,现场出现连续枪声,至少10声以上。

-

- 国家安全部1月24日通报:某境外旅游穿搭博主,因常在视频中“夹带私货,散布歪曲事实、抹黑中国国家形象的言论”而被中国当局封禁。其粉丝陈某,接他人询问观看渠道,遂从境外搬运作品,二次剪辑后售卖给境内粉丝。

安全机关查处认定,其向千余人传播出售“危害国家安全”的视频数十条,获利数万元,“等待陈某的将是法律的严惩”。 - 张又侠、刘振立涉嫌严重违纪违法被立案审查调查

中央政治局委员、中央军委副主席张又侠,中央军委委员、中央军委联合参谋部参谋长刘振立涉嫌严重违纪违法,经党中央研究,决定对张又侠、刘振立立案审查调查。

中华人民共和国国防部 - AdGuard 开源 VPN 协议 TrustTunnel

2026 年 1 月 21 日,AdGuard 在官方博客宣布:已将驱动 AdGuard VPN 的自研协议正式开源,并命名为 TrustTunnel,允许外界查看、审计、复用与二次开发。此前它已在 AdGuard VPN 的移动端、桌面端与浏览器扩展中使用。

工作方式上,TrustTunnel 试图把隧道流量“伪装成普通 HTTPS 访问”:使用 TLS 加密,并以 HTTP/2 或 HTTP/3(基于 QUIC)作为传输层;连接以“数据流”组织,每个连接对应独立 stream,以降低被网络层识别、限速或封锁的概率,并提升在不稳定网络下的可用性。开源内容包括:首版协议规范、以及服务端与客户端的参考实现代码;AdGuard 强调无需安装 AdGuard VPN 也能使用,可自建服务器并用开源客户端接入。项目采用 Apache-2.0 许可证。

特性上具有灵活路由/分流(哪些请求走隧道、哪些走本地)、按域名或应用进行精细化控制、以及实时请求日志用于展示流量去向与规则命中情况。服务端/库侧则强调可转发 TCP/UDP/ICMP,并支持系统级隧道与 SOCKS5 等形态。

代码开源本身并不等同于已完成独立安全审计,后续仍取决于社区审查与审计进展。

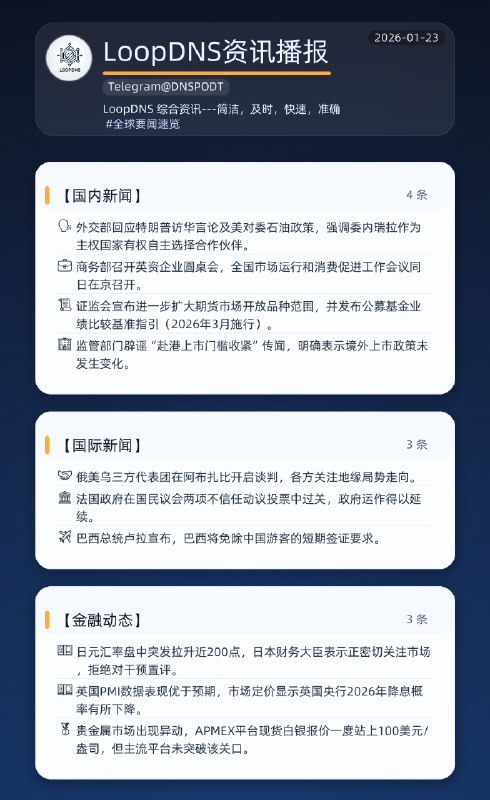

Adguard blog - 🌏 #全球要闻速览 2026-01-23

- 重要/漏洞:GNU InetUtils telnetd 存在远程身份验证绕过漏洞

漏洞编号: CVE-2026-24061

重要等级: 严重(高危)

CVSS 分数:CNA/MITRE 9.8

影响范围:

GNU InetUtils 版本: 1.9.3 至 2.7 (含 2.7)

受影响系统:任何使用上述受影响版本 GNU InetUtils 软件包作为 telnetd 服务的操作系统。

部分基于 Linux 的嵌入式设备、网络设备和物联网设备也可能受到影响,用户需自行确认其设备上 telnetd 服务的具体实现和版本。

漏洞原理:

该漏洞存在于受影响版本 telnetd 服务的登录处理逻辑中。当 telnetd 服务调用系统的 login 程序来验证用户时,它会接收并使用客户端通过 Telnet 协议发送的 USER 环境变量。

由于 telnetd 服务未对该 USER 变量进行任何安全检查或净化,就直接将其拼接到 login 命令的参数中。login 程序本身支持一个 -f <用户名> 参数,该参数用于跳过密码验证,直接信任并登录指定用户。

攻击者可以通过构造一个特制的 USER 环境变量(如 "-f root"),并使用 telnet 客户端的 -a (自动登录) 参数将其发送至服务器。服务器端的 telnetd 进程会执行类似以下的命令模板:PATH_LOGIN " -p -h %h %?u{-f %u}{%U}"

其中 %U 被替换为恶意的 USER 环境变量,导致最终执行 login ... -f root,从而绕过所有身份验证机制,直接获取 root shell。

注意:

这是一个无需任何前提条件的远程身份验证绕过漏洞。攻击者只要能够通过网络访问到目标服务器的 Telnet 端口,就可以直接获取最高管理员(root)权限。Telnet 协议本身是明文传输的,极其不安全,强烈建议不要在任何生产环境中使用。

受影响组件:GNU InetUtils telnetd 服务

具体接口:Telnet 登录协议处理流程

受影响参数:USER 环境变量

处置建议:

立即禁用并停用 telnetd 服务。这是最安全、最推荐的措施。请使用加密的 SSH 协议作为远程管理的替代方案。

消息来源:CVE-2026-24061 - 第一财经23日求证获悉,今日关于“证监会将收紧内地企业赴港上市门槛,设300亿市值下限”消息不实,当前境外上市政策没有变化。

- 中国通知阿里巴巴等头部科技公司准备下单英伟达 H200

据消息人士透露,中国相关部门已告知包括阿里巴巴、腾讯和字节跳动在内的多家大型科技公司,可以着手准备采购英伟达的 H200 人工智能芯片。监管机构已在原则上批准这些公司推进前期准备工作,允许其就采购数量等具体事项展开沟通。作为条件之一,北京方面将要求相关企业同时采购一定数量的国产芯片,但具体比例或数量尚未确定。英伟达、中国商务部以及上述公司均未就此回应置评请求。

来源:彭博社 - 微软在开源项目 VibeVoice 中发布并开源 VibeVoice-ASR

一个统一的语音转文本模型,目标是在一次推理中处理最长约 60 分钟的连续音频。该模型基于长上下文(官方描述为 64K token),在单次推理里联合完成语音识别、说话人区分与时间戳对齐,输出包含 Who(说话人)、When(时间戳)和 What(内容)的结构化转录结果

VibeVoice-ASR 支持用户自定义上下文/热词(如专有名词、技术术语、背景信息)以引导识别、提升领域内容的转录效果;官方提供在线 Playground 试用,并在 Hugging Face 发布权重(GitHub README 中标注为 “VibeVoice-ASR-7B”,模型卡显示约 9B 参数),许可证为 MIT。

huggingface - FlashLabs Chroma 1.0 发布

GitHub README 披露了模型结构:Reasoner 基于 Qwen2.5-Omni-3B,Backbone/Decoder 基于 Llama3,音频 codec 采用 24kHz 的 Mimi;项目声明模型语言为英文、许可证为 Apache-2.0。FlashLabs 于 2026 年 1 月 22 日宣布开源发布 Chroma 1.0,定位为“端到端、实时、speech-to-speech”的语音 AI 模型,并提供个性化语音克隆能力

Chroma 以“原生语音”方式工作,试图绕开传统“ASR→LLM→TTS”级联链路带来的延迟;其宣称端到端首响应时间(TTFT)低于 150ms,并在接入 SGLang 后可做到约 135ms。配套技术报告将关键机制归因于交错的文本-音频 token 调度(1:2)与流式生成;摘要给出的实验指标包括 Real-Time Factor(RTF)0.43,以及在说话人相似度上相对“人类基线”提升 10.96%。

Github - 彭博:在境外融资热潮引发担忧后,中国证监会正考虑收紧内地企业在香港发售股票的相关标准,以遏制过度投机并确保境外发行人质量,其中可能包括设定最低市值限制等措施。另外,寻求在香港双重上市的中国上市公司也面临着更严格的审查。 source

-

去年DeepSeek R1的论文刚出来时,引起英伟达短期大跌,我说是跌错了,因为这个开源模型其实是利好,加速了技术扩散,整个模型还是基于GPU的。

前几天DeepSeek刚发的Engram架构,我认为是不亚于R1的优秀论文,但却是对GPU真正的利空。因为它实现了将常识性的内容分流到CPU上,让GPU专注于深度思考,需要世界知识时再去CPU调用,大幅提升了模型的计算效率。

消融实验发现用20%的参数记忆知识,80%的参数计算推理,性能达到最佳,例如简单的问题“法国的首都是哪里?”,普通模型得GPU算到第20层才知道答案是巴黎,Engram模型在第2层去CPU查个表,就心里有数了。

xueqiu.com -