LoopDNS资讯播报

-

- Google Genie 3世界模型开始向美国Google AI Ultra用户开放体验

2026年1月29日,Google在官方博客宣布推出Project Genie(实验性研究原型),并称已开始在美国向Google AI Ultra订阅用户(18岁以上)逐步开放访问,用于创建、探索并混搭重制交互式世界。

google blog - Google DeepMind 发布 AlphaGenome

2026年1月28日,Google DeepMind 在《Nature》发表论文《Advancing regulatory variant effect prediction with AlphaGenome》(DOI:10.1038/s41586-025-10014-0),并在官方博客更新中给出模型获取入口与代码资源;AlphaGenome 早在2025年6月25日已通过非商业研究用途的API提供预览访问。

Google Deepmind - Qwen 开源 Qwen3-ASR 与 Qwen3-ForcedAligner

Qwen 团队在 2026 年 1 月 29 日宣布开源 Qwen3-ASR 系列(1.7B、0.6B)及 Qwen3-ForcedAligner-0.6B,并在 GitHub 提供代码与推理/部署示例;模型权重同步发布到 Hugging Face/ModelScope,项目采用 Apache-2.0 许可证。

huggingface -

- 特朗普宣布前美联储理事凯文·沃什为美联储主席候选人。

“我认识凯文很久了,我毫不怀疑他将成为美联储历史上最伟大的主席之一,甚至可能是最伟大的主席。他简直就是完美人选,绝对不会让人失望。” - 台湾,教育部常务次长朱俊彰1月30日表示,抖音、小红书、微信、微博、百度云盘等App已被数发部认定有信息安全风险,且危害儿少身心健康。除数发部已采取的禁止校园公务设备下载使用、中小学TANet阻断上述服务的措施外,教育部所属机关学校iTaiwan无线网也将阻断上述服务。

目前,台湾中小学TANet的过滤机制均为DNS阻断,用户在浏览器设置DoH即会失效。去年12月警方在全台阻断小红书域名解析,也仅影响了其网页加载,App仍可照常使用。 - 预测市场Polymarket最新显示,沃什被特朗普提名为美联储新主席的概率飙升至95%。

沃什长期以偏鹰派立场著称,这一预期迅速推升美元和美债收益率,并对商品价格形成压制。内外盘期货普遍下行,贵金属成为跌幅最为集中的品种。

沃什曾在近期的一场深度访谈中直言,通胀是美联储的责任,不能归咎于外界因素。他给出的改革方案并非推倒重来,而是主张美联储需要"复兴"而非"革命"。针对高利率困境,沃什认为,可以通过缩表换取低利率空间。"如果我们让印钞机安静一点,利率其实可以更低。"

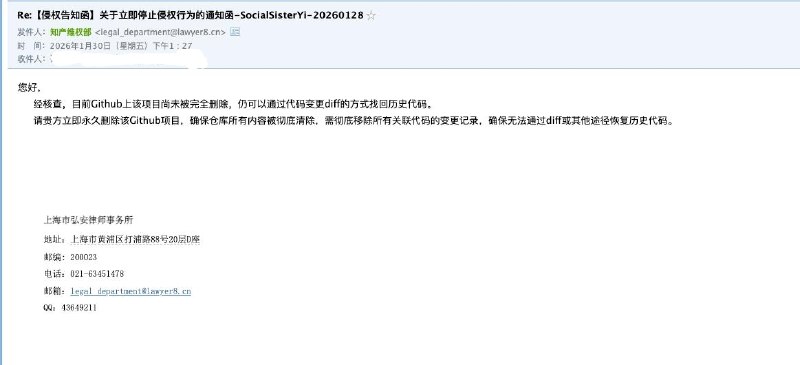

wallstreetcn.com/articles/3761461 - 后续:BiliBili法务部门要求彻底清除GitHub项目历史记录

在1月28日宣布永久关停后,GitHub上的bilibili-API-collect项目继续受到B站法务部门的关注。根据1月30日发出的律师函,B站指出尽管项目已归档为只读状态,但通过代码变更历史(diff)等方式,侵权内容仍可能被恢复。法务部门要求项目方彻底删除所有相关代码及历史记录,确保无法恢复。若未能满足此要求,B站将继续采取法律措施。 - 巴拿马最高法院宣布,长江和记实业子公司和记港口持有的巴拿马运河两端主要港口(巴尔博亚港和克里斯托瓦尔港)的特许权违宪。

巴拿马审计长诉讼指控政府审计存在违规行为。

法院声明称,裁决经过“广泛的审议和讨论”。巴拿马将对上述港口进行招标。

长和股价一度跌超5%。

来源:FT - 监管通报某基金公司违规销售:责令改正并暂停新发 追究总经理等相关负责人责任

近日监管发布机构监管通报称,某基金公司管理的基金产品单日申购量超百亿,涉嫌违规销售,经核查,基金公司与不具备基金销售业务资格和基金从业资格的互联网“大V”开展营销合作,向其支付大额广告费,以互联网“大V”在平台上预告某日(将)大额购入D基金公司的A产品为噱头,利用互联网“大V”的流量和影响力鼓动投资者跟进购买A产品,诱导风险承受能力不匹配的投资者购买中高风险产品。经查,公司未对投资者充分揭示风险,投资者适当性管理不到位,违法相关法律法规,监管对该公司采取责令改正并暂停受理公募基金产品注册的监管措施,同步追究公司总经理、督察长、互联网业务部门负责人等责任人员责任。

-

-

- 闪迪:我们正与 NVIDIA 及其客户沟通配置问题。目前这一需求还没计入我们的预测中。初步预估,到2027年这可能带来额外 75-100 EB 的需求,次年可能翻倍。这再次证明 NAND 在 AI 架构中的核心地位。

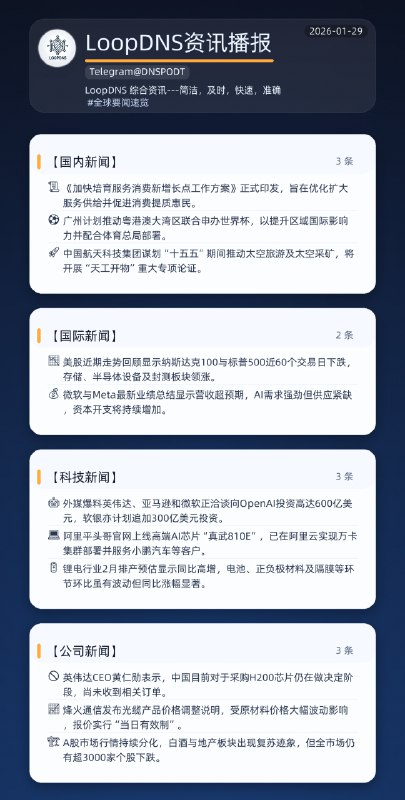

- 🌏 #全球要闻速览 2026-01-29

- 23:23财联社1月29日电,正在交易中的沪金、沪银期货夜盘出现短时大幅跳水行情,一度分别下探6%、4%。

- 产业发展,总书记强调不能喜新厌旧

在省部级主要领导干部学习贯彻党的二十届四中全会精神专题研讨班开班式上,习近平强调,产业发展不能一哄而上、跟风冒进,更不能喜新厌旧、把传统产业优势丢掉。

在2025年底召开的中央经济工作会议上,习近平指出:“一些地方不顾实际,盲目追风口。看别人搞芯片,自己也搞。看别人搞‘新三样’,自己也不甘落后。”针对一些现象,总书记打了个形象的比方,“生物有多样性,地区有差异性,有老年人,有青年人,有的年幼有的年长,为什么都选择干一样的活呢?” - 谷歌开源 LiteRT

面向边缘/终端设备的高性能机器学习与生成式 AI 部署框架,强调“转换(conversion)—运行时(runtime)—优化(optimization)”一体化工作流,并把重点放在端侧推理性能与硬件加速落地。LiteRT 的定位并非“从零重写”,而是 TensorFlow Lite(TFLite)的更名与演进路线:Google 在 2024 年 9 月明确表示,LiteRT 是 TFLite 的新名称,目标是更贴近多框架生态(PyTorch/JAX/Keras 等),同时对既有应用尽量“低扰动”。文件格式层面也保持兼容:.tflite 扩展名与 FlatBuffer 格式不变,原有 .tflite 模型可由 LiteRT 读取。

LiteRT 2.x 将重心从传统的 Interpreter(解释器式执行)推向 CompiledModel(编译式/硬件感知执行)API:官方文档将其定义为“现代标准”的端侧推理接口,优先承载新的性能特性与加速能力;其核心机制包括自动选择 CPU/GPU/NPU 后端、异步执行,以及更高效的 I/O 缓冲管理(面向端到端延迟而非仅算子吞吐)。

Github - 月之暗面开源 Kimi K2.5,并发布Kimi Agent SDK

1月27日,月之暗面(Kimi)发布并开源新一代模型 Kimi K2.5,并称已在 kimi.com、Kimi App、Kimi API 等渠道上线。可理解文本、图像与视频,并引入 Agent Swarm(智能体集群)来并行拆解和执行复杂任务。

从 Hugging Face 模型卡披露的信息看,K2.5 为 MoE 架构,总参数 1T、激活参数 32B,384 个专家、每 token 选择 8 个专家;上下文长度 256K;并使用 MoonViT 视觉编码器(约 4 亿参数)。模型卡同时给出多项推理/视觉/代码/检索类基准成绩,并包含“原生 INT4 量化”和部署建议(vLLM、SGLang、KTransformers 等),并注明“视频内容对话”在第三方部署下仍属实验能力、目前仅官方 API 支持。

开源协议方面,Hugging Face 显示为 modified MIT;其中一项“修改”条款要求:若模型(或其衍生作品)用于月活超过 1 亿或月营收超过 2000 万美元的商业产品/服务,需要在该产品/服务界面显著展示 “Kimi K2.5”。

价格方面: kimi-k2.5 缓存命中输入 ¥0.70/1M tokens、输入 ¥4.00/1M tokens、输出 ¥21.00/1M tokens,并标注上下文 262,144 tokens。同时 MoonshotAI 在 GitHub 发布并开源 Kimi Agent SDK,定位为一组多语言库,用编程方式调用 Kimi Code(Kimi CLI)的智能体运行时,面向产品集成、自动化与自定义工具开发。

huggingface - “十四五”期间全国重污染天数减少25% 环境持续向好

记者从28日召开的生态环境部发布会上了解到,经过五年不懈努力,全国PM2.5浓度累计下降20%,重污染天数减少25%,全国各项环境监测指数显著提升,持续向好。“十四五”期间,全国PM2.5浓度累计下降20%,优良天数比例创有监测以来最好水平,重污染天数减少25%;全国地表水Ⅰ—Ⅲ类水质断面比例累计上升8个百分点,长江干流连续6年、黄河干流连续4年全线水质稳定保持Ⅱ类,太湖连续2年水质达到Ⅲ类;近岸海域水质优良比例较2020年提高7.5个百分点,主要污染物排放总量持续下降。实现空气质量、水环境质量、城乡人居环境“三个明显改善”和重污染天气、劣Ⅴ类断面、城市黑臭水体“三个基本消除”,人民群众生态环境满意度连续4年超过90%,生态环境获得感、幸福感、安全感进一步增强。

消息来源: 央视新闻